Como deepfakes estão mudando o que nós lembramos

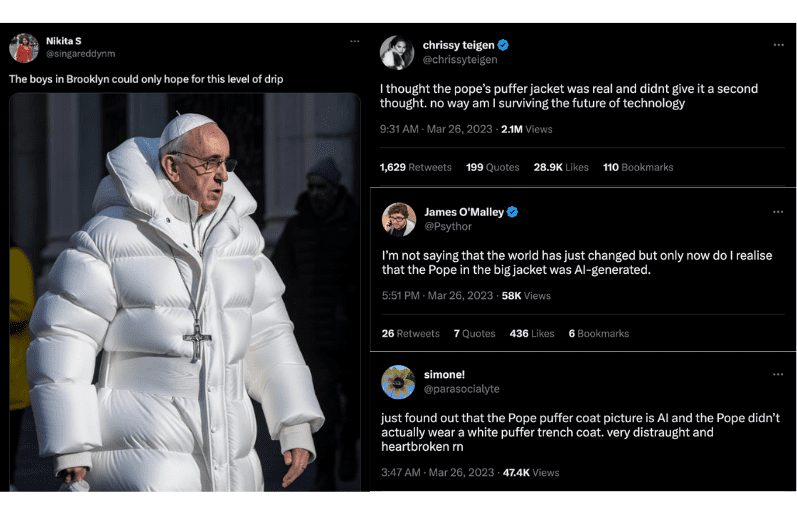

A Internet tem sido abalada por algumas imagens incompreensíveis ultimamente. O papa de jaqueta e Vladimir Putin de joelhos beijando a mão de Xi Jinping. A pegadinha? Nenhum desses eventos realmente aconteceu. Eles são o produto da avançada tecnologia de IA conhecida como deepfakes.

Essas falsificações baseadas em aprendizado profundo mostram a facilidade com que a IA pode obscurecer os limites entre realidade e ficção, com implicações significativas e de longo alcance.

[Proteja sua atividade online e mantenha suas informações pessoais privadas com um teste sem compromisso da nossa VPN .]

Investigamos detalhadamente como a IA está mudando a maneira como nos lembramos e como os deepfakes podem potencialmente contribuir para o fenômeno conhecido como Efeito Mandela. Prepare-se para questionar tudo o que você achava que sabia.

O que é o efeito Mandela?

Este termo tem o nome de Nelson Mandela, um revolucionário e político sul-africano antiapartheid. Muitas pessoas acreditavam que ele morreu na prisão na década de 1980, apesar de muitas provas de que não. Na verdade, ele foi libertado em 1990, tornou-se presidente do país do sul da África e acabou falecendo em 2013.

Desde então, o Efeito Mandela tem sido usado para descrever uma variedade de eventos ou informações que são lembrados incorretamente, incluindo a grafia de nomes de marcas, letras de músicas, enredo de filmes ou programas de TV e detalhes de eventos históricos.

Um exemplo do Efeito Mandela envolve o popular comediante dos anos 1990, Sinbad. Muitas pessoas afirmam se lembrar de um filme chamado Shazaam (não confundir com o filme de super-heróis de 2019, Shazam!), em que Sinbad interpreta um gênio que ajuda duas crianças. No entanto, tal filme nunca foi feito. A coisa mais próxima disso foi um filme chamado Kazaam, estrelado por Shaquille O'Neal como um gênio.

Apesar da falta de evidências de que Shazaam existe, muitas pessoas ficam convencidas de que o viram e se lembram de detalhes sobre o enredo, os personagens e até mesmo como era o pôster do filme. Embora o próprio Sinbad tenha confirmado que nunca interpretou um gênio, a ideia do filme tornou-se tão arraigada na memória das pessoas que elas têm certeza absoluta de que ele existe.

O que causa o Efeito Mandela?

Embora a causa do Efeito Mandela não seja totalmente compreendida, existem várias teorias que tentam explicá-lo. Uma sugere que seja resultado de falsas memórias, onde as pessoas se lembram de eventos ou fatos incorretamente devido a desinformação, má interpretação ou poder de sugestão. Outra teoria mais abrangente é que é devido a uma falha na matriz ou em um universo paralelo, onde as pessoas podem ter experimentado uma versão diferente da realidade.

Os psicólogos acham que o Efeito Mandela pode ser causado pela forma como nossos cérebros são conectados. Especificamente, como nossas mentes às vezes podem ser influenciadas por coisas como o que outras pessoas dizem ou nossas próprias crenças pré-existentes, que podem nos levar a lembrar das coisas incorretamente. Isso é chamado de viés cognitivo. Por exemplo, se muitas pessoas nas redes sociais dizem que algo aconteceu de certa forma, isso pode nos fazer acreditar que realmente aconteceu daquela forma, mesmo que não tenha acontecido.

Embora o Efeito Mandela não seja uma ocorrência recente e esteja relacionado principalmente à cultura pop, o surgimento de deepfakes significa que informações falsas podem se espalhar de maneira ainda mais rápida e fácil, e que mais pessoas podem começar a se lembrar de coisas que nunca aconteceram.

Isso levanta questões importantes sobre se podemos confiar nas informações que vemos online, se é correto usar IA para manipular imagens e vídeos e quanto poder a tecnologia deve ter para moldar nossas memórias e crenças.

O perigo das memórias derivadas de deepfake

Deepfakes usam IA para criar vídeos e imagens realistas de pessoas dizendo e fazendo coisas que nunca disseram ou fizeram. A tecnologia é baseada em aprendizado profundo, um tipo de aprendizado de máquina que envolve o treinamento de redes neurais artificiais em grandes quantidades de dados.

Em 2019, havia menos de 15.000 deepfakes detectados online. Hoje, esse número está na casa dos milhões, com o número de deepfakes criados por especialistas continuando a aumentar a uma taxa anual de 900%, de acordo com o Fórum Econômico Mundial.

Um dos aspectos mais preocupantes dos deepfakes é seu potencial de ser usado para fins maliciosos, como criar notícias ou propaganda falsas ou se passar por alguém para obter ganhos financeiros. A tecnologia também está sendo usada para criar pornografia deepfake, o que levantou preocupações sobre a exploração de indivíduos e o potencial de abuso.

Deepfakes também têm o poder de fazer as pessoas acreditarem que viram algo que nunca aconteceu, devido à natureza altamente realista da tecnologia. Em última análise, isso pode levá-los a se lembrar de um acontecimento falso como um fato.

Aqui estão alguns exemplos de como os deepfakes podem contribuir para o Efeito Mandela e os perigos que os acompanham:

Criação de notícias falsas

Deepfakes podem ser usados para criar notícias falsas que são tão realistas que as pessoas acreditam que sejam verdadeiras, mesmo que sejam completamente fabricadas. Por exemplo, notícias falsas, como ataques terroristas ou desastres naturais, que foram criadas com o único propósito de impulsionar certas agendas sociopolíticas. Se essas histórias forem criadas com deepfakes, elas podem se parecer com reportagens reais, completas com vídeo e áudio convincentes. Isso poderia criar uma visão distorcida da história e dos eventos para as gerações vindouras.

Opinião política oscilante

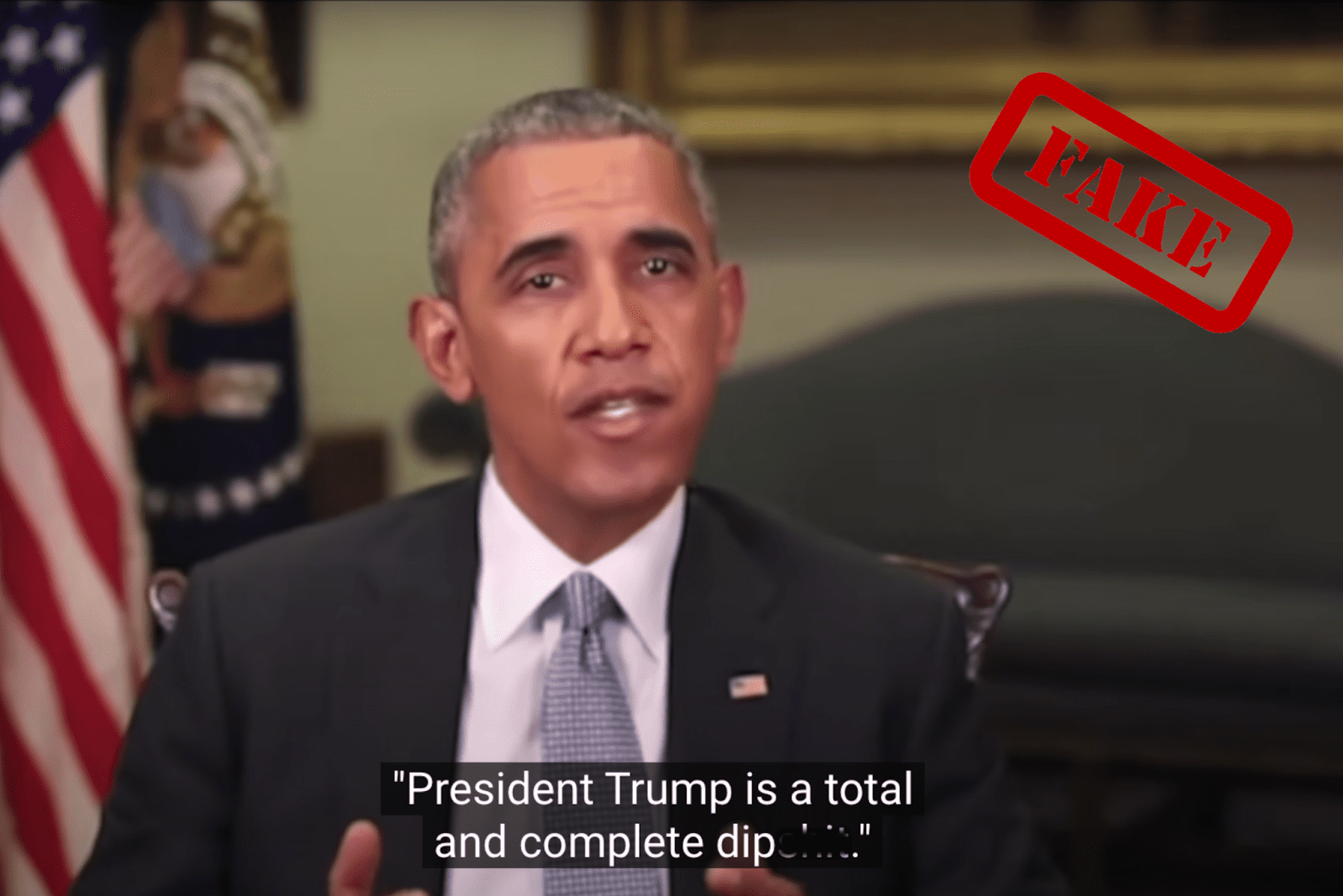

Alguns meses antes das eleições de meio de mandato de 2018, um vídeo deepfake de Barack Obama xingando com um palavrão o então presidente Donald Trump se tornou viral. Foi criado pelo diretor vencedor do Oscar, Jordan Peele, para servir como um alerta sobre os usuários que confiam no material que encontram online. Ironicamente, o tiro saiu pela culatra depois que muitos dos apoiadores de Trump acreditaram que era real, com hordas deles indo para a mídia social para expressar sua indignação.

Se um vídeo deepfake semelhante de um candidato político ou figura pública dizendo ou fazendo algo que nunca realmente aconteceu fosse convincente o suficiente, isso poderia ter efeitos prejudiciais no funcionamento da democracia e na confiança que as pessoas têm nas instituições.

Por exemplo, à medida que mais pessoas sejam expostas a um vídeo deepfake potencialmente convincente dos candidatos políticos de seu país nas mídias sociais ou por meio de vários meios de comunicação, memórias falsas poderiam se espalhar e serem aceitas como verdadeiras. Isso pode influenciar em quem as pessoas votam nas eleições e quem elas escolhem para serem seus líderes.

Condução de campanhas de propaganda

Campanhas de propaganda criadas com deepfakes podem ser usadas para manipular a opinião pública e espalhar desinformação sobre grupos patrocinados pelo estado, levando a uma visão distorcida da realidade. Por exemplo, em referência ao conflito em curso com a Rússia, a inteligência ucraniana alertou recentemente que um deepfake do presidente ucraniano Volodymyr Zelenskyy estava circulando, no qual ele é visto pedindo que os ucranianos se rendam.

Apesar de muitas plataformas retirarem o vídeo, ele continua aparecendo em vários sites de mídia social como Facebook, Reddit e TikTok, semeando discórdia entre o público e tornando mais difícil para as pessoas discernir a verdade.

Alterando imagens históricas

Deepfakes podem ser usados para alterar filmagens históricas, como filmagens de discursos políticos ou eventos importantes, de forma a mudar as memórias das pessoas sobre o que realmente aconteceu. Isso pode levar a confusão e incerteza sobre o que realmente aconteceu no passado, corroendo a confiança do público nos registros históricos e na mídia, alimentando, em última análise, as teorias da conspiração.

Veja o pouso na lua, por exemplo. Até hoje, algumas pessoas afirmam que foi falsificado e nunca realmente aconteceu. Deepfakes podem ser utilizados para fabricar vídeos e gravações de áudio convincentes que reforçam essa falsa narrativa, intensificando o ceticismo e a desconfiança na autenticidade do evento histórico.

Manipulação de conteúdo de mídia social

Com a facilidade de acesso às plataformas de mídia social, os deepfakes podem ser usados para criar postagens falsas que fazem parecer que celebridades, figuras públicas ou influenciadores estão presentes em um evento ou endossando um determinado produto quando na realidade não estão. Ao permitir que narrativas falsas se espalhem sem controle, os deepfakes podem polarizar ainda mais a sociedade e criar um terreno fértil para campanhas de desinformação. Isso, por sua vez, mina a credibilidade das mídias sociais como ferramenta de comunicação, que é fundamental para a democracia e a coesão social.

Fabricação de evidências científicas

Desde as origens de um vírus até descobertas médicas, os deepfakes podem ser usados para criar evidências científicas falsas para apoiar uma afirmação ou hipótese falsa. Por exemplo, algumas pessoas tentam espalhar desinformação sobre a mudança climática, apesar da esmagadora evidência científica de que ela é causada pela atividade humana. Isso representa uma ameaça para questões importantes como o aquecimento global.

Deepfakes podem criar evidências científicas falsas que afirmam que a mudança climática é causada por fatores externos, o que pode ter sérias implicações; os formuladores de políticas podem ser menos propensos a tomar medidas para lidar com as mudanças climáticas se houver um ceticismo generalizado sobre suas causas. Isso poderia dividir ainda mais a opinião pública e tornar mais difícil chegar a um consenso sobre como abordar essa questão urgente.

Criando álibis falsos

Além disso, os deepfakes também podem ser usados para criar confissões ou declarações falsas em processos judiciais ou para manipular imagens de vídeos de segurança para criar álibis para criminosos. Isso pode levar à criação de falsas narrativas em torno dos eventos do crime, com as pessoas acreditando a) que o perpetrador não cometeu o crime ou b) que uma pessoa inocente o cometeu. Com o tempo, essa falsa narrativa pode ficar arraigada na memória coletiva dos envolvidos no caso, que acreditam que ela de fato ocorreu.

Hipoteticamente, digamos que haja um caso criminal envolvendo uma personalidade importante onde a equipe de defesa cria um vídeo deepfake altamente realista mostrando o réu em um local diferente no momento do crime. O vídeo é amplamente divulgado e muitas pessoas passam a acreditar que o réu não poderia ter cometido o assassinato. Mesmo que posteriormente seja provado que o vídeo é deepfake e o réu seja considerado culpado, algumas pessoas podem continuar acreditando que o réu era inocente devido à memória do vídeo.

10 maneiras de identificar um deepfake

Nas sábias palavras de Abraham Lincoln: “Nunca confie em nada que você vê na Internet”. Para combater o problema dos deepfakes criarem memórias falsas, é essencial que todos nós permaneçamos críticos e céticos em relação às informações que consumimos, e que empresas de tecnologia e governos trabalhem juntos para desenvolver soluções para detectar e prevenir a disseminação de vídeos deepfake.

Enquanto isso, aprenda a identificar um deepfake para se proteger da disseminação de desinformação e falsas memórias:

- Distorções e transformações faciais

- Procure iluminação e distorções de conversão 3D no rosto

- Verifique se há inconsistências na textura, especialmente nas bochechas, testa, sobrancelhas e pelos faciais.

- Movimentos realistas dos olhos e lábios

- Verifique se o sombreamento, a cor dos olhos e os movimentos das manchas faciais e piscadas parecem realistas.

- Verifique se os lábios da pessoa parecem naturais e pertencem a esse rosto.

- Movimentos e gestos da pessoa

- Preste atenção aos movimentos e gestos da pessoa no vídeo.

- Observe se eles parecem estranhos ou muito perfeitos.

- Análise de áudio

- Ouça com atenção o áudio do vídeo.

- Verifique se a voz soa artificial ou tem distorções, pois o áudio pode estar usando vozes alteradas ou geradas por IA.

- Inconsistências na iluminação e reflexos

- Procure inconsistências de iluminação e reflexos que possam não corresponder ao ambiente ou à posição da pessoa no vídeo ou imagem.

- Verifique o conteúdo do vídeo

- Encontre o vídeo original ou procure outros exemplos dele para verificar seu conteúdo

- Use a pesquisa reversa de imagens com ferramentas como Google Image Search, TinEye, SauceNAO ou Bing Visual Search.

- Análise contextual

- Avalie o contexto em que o vídeo foi postado ou compartilhado, pois pode indicar se é genuíno ou não (por exemplo, por que o papa repentinamente se desviaria das regalias típicas frequentemente usadas na casa papal?).

- Verifique a fonte original do vídeo, se é uma organização de notícias respeitável, uma pessoa aleatória nas mídias sociais ou um indivíduo com uma agenda questionável.

- Situações não naturais ou incomuns

- Desconfie de vídeos que mostrem situações incomuns ou improváveis, como uma pessoa famosa fazendo algo fora do normal ou uma figura política dizendo algo controverso.

- Verifique os metadados

- Verifique os metadados do vídeo para ver se correspondem às afirmações feitas no vídeo, como a hora e o local da gravação.

- Lembre-se de que os metadados podem ser facilmente alterados, portanto, não devem ser a única base para determinar a autenticidade de um vídeo.

- Mantenha-se atualizado

- Esteja ciente de que a tecnologia usada para criar deepfakes está melhorando constantemente e pode se tornar mais difícil identificá-los no futuro.

- Não deixe de se manter atualizado sobre os novos desenvolvimentos nesta área e seja cauteloso ao compartilhar ou reagir a vídeos que pareçam suspeitos ou extremamente interessantes.

Dê o primeiro passo para se proteger online. Experimente a ExpressVPN sem riscos.

Obtenha ExpressVPN