DeepSeek vs. ChatGPT: qual ferramenta de IA protege melhor seus dados?

Os grandes modelos de linguagem (LLMs, na sigla em inglês) tornaram-se parte do cotidiano de milhões de pessoas. Ferramentas como ChatGPT e DeepSeek agora lidam com tudo, desde perguntas casuais até pesquisas de mercado e fluxos de trabalho internos.

Porém, quando você compartilha informações com um chatbot de IA, o que realmente acontece com esses dados?

Analisamos detalhadamente as políticas de privacidade e os termos de uso do ChatGPT e DeepSeek para entender como cada plataforma coleta, armazena e usa seus dados, bem como o que isso significa para a privacidade e a segurança no uso real.

Por que a segurança e a privacidade são importantes na hora de escolher uma IA

A privacidade de dados é um fator essencial ao escolher uma ferramenta de IA porque as entradas do usuário podem ser registradas, armazenadas ou usadas para treinamento e garantia de qualidade sob certas condições. As instruções são processadas em uma infraestrutura operada pelo provedor, fora do controle direto do usuário, e estão sujeitas às políticas de tratamento de dados da plataforma.

O risco aumenta à medida que a IA se torna parte integrante dos fluxos de trabalho diários. As pessoas usam chatbots de IA tanto em contextos pessoais, como aconselhamento financeiro, decisões de carreira e dúvidas médicas, quanto em contextos profissionais, como documentação interna, revisão de código, planejamento estratégico e muito mais. Esses são dados sensíveis que você provavelmente não deseja que as empresas de IA usem para treinar seus modelos.

Ao comparar chatbots de IA, segurança e privacidade são tão importantes quanto a qualidade ou a velocidade das respostas. As práticas exatas de tratamento de dados variam de acordo com o provedor, o tipo de plano e as configurações do usuário, incluindo se as solicitações são armazenadas, revisadas ou usadas para aprimoramento do modelo. Algumas perguntas que você deve se fazer são:

- Quem pode acessar seus dados?

- Em que condições os dados podem ser reutilizados?

- Quanta visibilidade você tem sobre o que acontece depois que uma instrução é enviada?

Como ChatGPT e DeepSeek lidam com dados do usuário

Quando você interage com o ChatGPT ou DeepSeek, seus dados passam por diversas etapas após o envio. A forma como cada plataforma lida com esses dados é determinada por sua política de privacidade e termos de uso.

Na prática, o tratamento de dados abrange três aspectos:

- Como as instruções são processadas e registradas.

- Se a entrada do usuário pode ser usada além da resposta imediata.

- Por quanto tempo as informações permanecem nos sistemas do provedor.

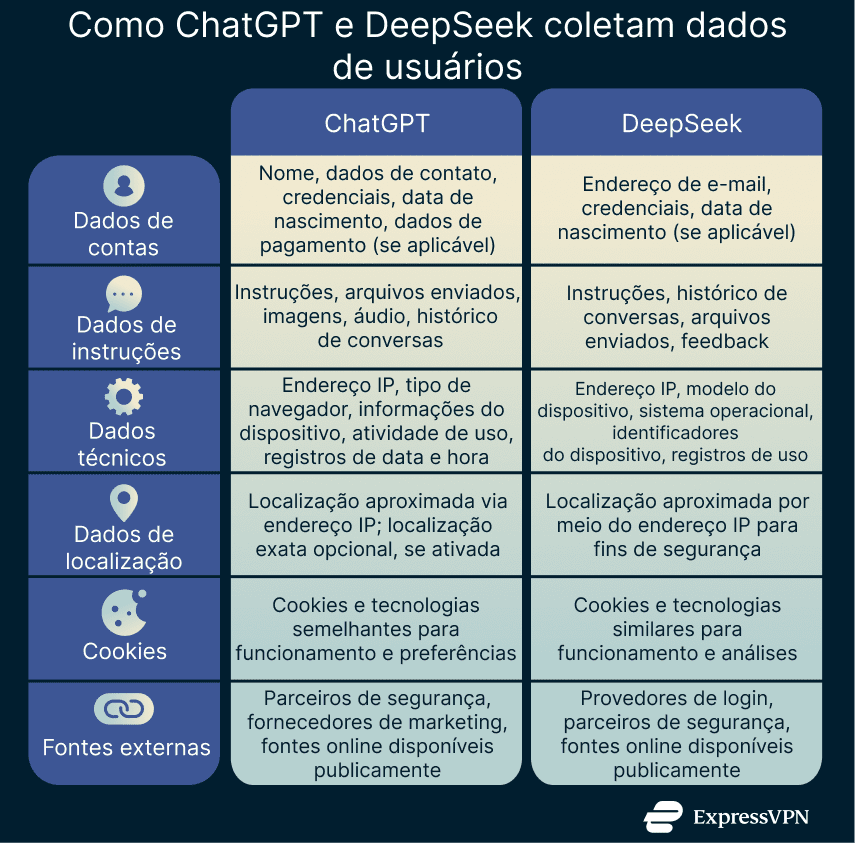

Coleta de dados e registro de instruções

ChatGPT e DeepSeek coletam dados de usuários como parte da operação de seus serviços. Isso inclui informações que você fornece, dados gerados por meio da interação com a plataforma e dados técnicos coletados automaticamente em segundo plano.

DeepSeek

O DeepSeek coleta dados pessoais quando você cria uma conta, envia instruções, carrega arquivos ou interage com o serviço de qualquer outra forma. Isso inclui informações da conta, como endereço de e-mail, nome de usuário e senha, bem como o conteúdo da conversa, como instruções, histórico do chat, feedback e materiais enviados.

Ele também coleta informações sobre o dispositivo e a rede, como endereço IP, identificadores do dispositivo, sistema operacional, idioma do sistema, registros de desempenho e relatórios de falhas. O DeepSeek atribui IDs de dispositivo e usuário para rastrear a atividade em diferentes sessões e dispositivos para fins de segurança e operacionais. A empresa também registra como os usuários interagem com os recursos, registra a localização aproximada com base no endereço IP por motivos de segurança e usa cookies e tecnologias semelhantes para operar e analisar o serviço.

A política de privacidade do DeepSeek também observa que ele pode receber dados pessoais de terceiros, como provedores de login, parceiros de segurança e fontes online disponíveis publicamente. O DeepSeek afirma que o serviço não é projetado para processar dados pessoais confidenciais e adverte explicitamente os usuários para não enviarem tais informações.

ChatGPT

O ChatGPT coleta dados pessoais quando você cria uma conta, envia instruções, carrega conteúdo ou se comunica com a OpenAI. Isso inclui informações da conta, como nome, dados de contato, credenciais e informações de pagamento, quando aplicável. O conteúdo do usuário inclui mensagens, arquivos carregados, imagens e áudio, dependendo dos recursos utilizados.

A OpenAI também afirma em sua política de privacidade que coleta dados técnicos gerados pelo uso do serviço, como endereço IP, tipo de navegador, registros de data e hora, logs de interação, padrões de uso, informações do dispositivo e localização geral inferida a partir do endereço IP. Esses dados são utilizados para dar suporte à funcionalidade do serviço, monitoramento de segurança e otimização de desempenho. Cookies e tecnologias similares são usados para manter as preferências e melhorar a experiência do usuário.

Além disso, a OpenAI recebe dados de parceiros confiáveis, como provedores de segurança e fornecedores de marketing, e afirma coletar informações disponíveis publicamente na internet para desenvolver os modelos que alimentam seus serviços.

Utilização de dados do usuário para treinamento de modelos

As instruções fornecidas pelos usuários não apenas geram respostas; em algumas implantações, elas também podem ser coletadas e analisadas para embasar melhorias futuras dos modelos.

DeepSeek

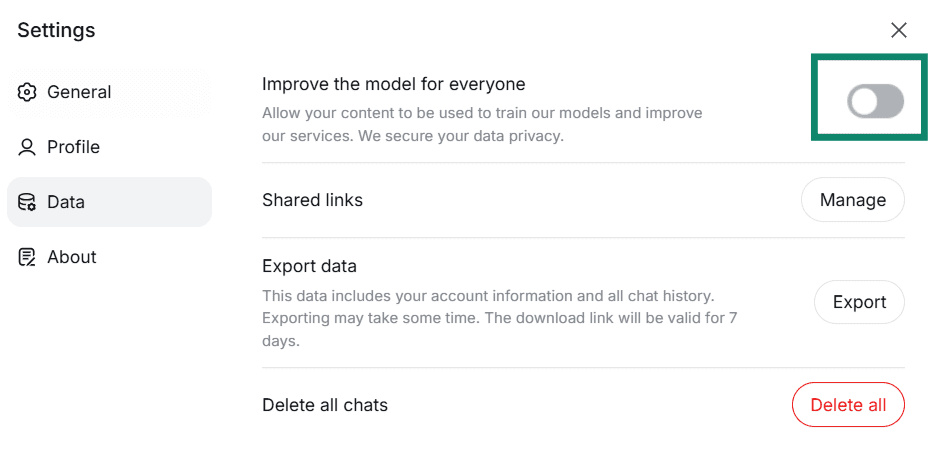

O DeepSeek processa dados do usuário para operar e aprimorar seus serviços, o que pode incluir o desenvolvimento de modelos. Assim como no ChatGPT, você pode optar por não compartilhar seu conteúdo para fins de treinamento, bastando abrir a seção Settings (Configurações) e desativar a opção Improve the model for everyone (Melhorar o modelo para todos) na seção Dados.

ChatGPT

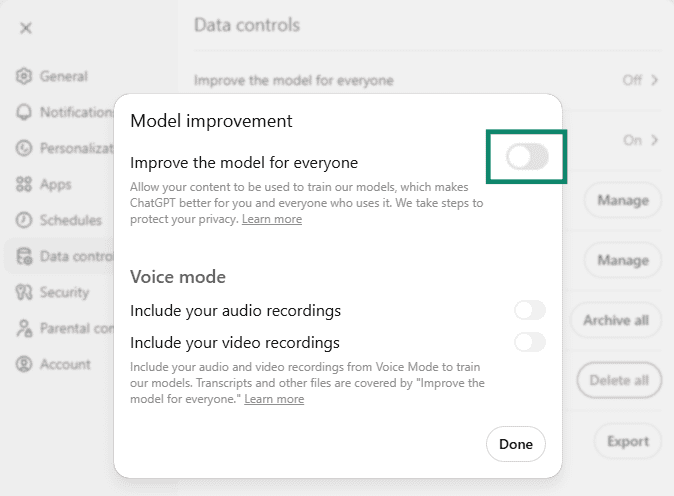

O ChatGPT pode aplicar análises automatizadas e revisões humanas para fins de qualidade e segurança. No entanto, você pode alterar os controles de dados padrão na seção Settings (Configurações) > Data Controls (Controles de dados) desativando a opção Improve the model for everyone (Melhorar o modelo para todos), o que impede o ChatGPT de utilizar seus dados para fins de treinamento. Quando essa configuração está desativada, as instruções futuras são excluídos dos fluxos de trabalho de treinamento, embora os dados coletados anteriormente ainda possam ser retidos e o conteúdo de seus chats possa ser acessado para outros fins, como a investigação de um incidente de segurança.

Controles de retenção e exclusão de dados

Tanto o DeepSeek quanto o ChatGPT retêm dados pessoais por motivos operacionais, legais e de segurança, mas o escopo e os controles diferem na prática.

DeepSeek

O DeepSeek retém informações pessoais pelo tempo necessário para fornecer seus serviços e cumprir obrigações legais, comerciais e contratuais. Normalmente, ele retém informações da conta, dados inseridos pelo usuário e dados de pagamento enquanto a conta estiver ativa. Caso você viole as políticas da plataforma, o DeepSeek poderá reter os dados relevantes mesmo após o encerramento da sua conta para investigar ou solucionar a violação.

Você pode excluir seu histórico de conversas nas configurações da sua conta, embora a política de privacidade do DeepSeek não especifique quanto tempo leva para que esses dados sejam removidos de seus servidores. Há também a opção de enviar uma solicitação para privacy@deepseek.com e pedir a exclusão dos seus dados. Algumas informações podem ser retidas quando necessário para fins legais ou de conformidade.

ChatGPT

Assim como o DeepSeek, o ChatGPT retém dados pessoais pelo tempo necessário para operar seus serviços ou para fins comerciais legítimos, como segurança, resolução de disputas e conformidade legal. O período de retenção depende de fatores como a finalidade do processamento, a sensibilidade dos dados, o risco potencial de acesso não autorizado e as obrigações legais aplicáveis.

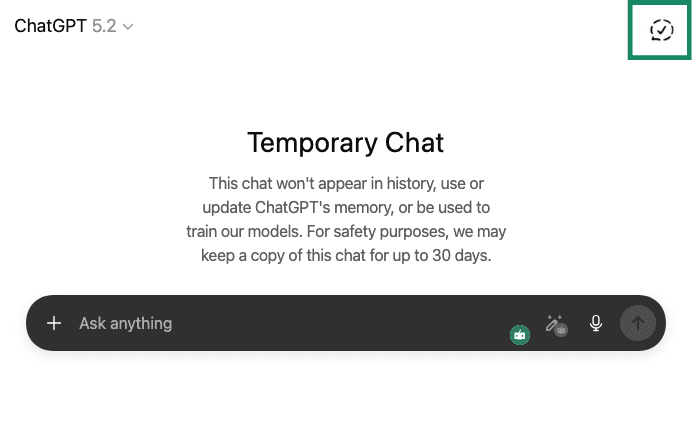

As configurações do usuário podem influenciar a retenção em alguns casos. Por exemplo, conversas temporárias não aparecem no histórico de conversas, mas são armazenadas nos servidores do ChatGPT por até 30 dias. O mesmo se aplica a conversas regulares que você excluiu do seu histórico de conversas.

Gerenciamento de dados através do Portal de Privacidade do ChatGPT

É possível acessar o Portal de Privacidade do ChatGPT em privacy.openai.com. Aqui você pode enviar solicitações formais relacionadas aos seus dados pessoais, incluindo exclusão, acesso, correção e outros direitos de privacidade. Ele vai além dos controles do aplicativo, como limpar o histórico de conversas, e permite que você faça solicitações de privacidade do consumidor diretamente à OpenAI.

No Portal de Privacidade, você pode:

- Excluir sua conta e os dados pessoais associados: o envio de uma solicitação para "excluir minha conta ChatGPT" removerá permanentemente sua conta e colocará seus dados em fila para exclusão nos sistemas da OpenAI, geralmente dentro de cerca de 30 dias.

- Solicitar acesso ou correção: usuários com os direitos legais pertinentes (por exemplo, de acordo com o Regulamento Geral de Proteção de Dados na UE) podem solicitar acesso ou correção de suas informações pessoais.

- Solicitar a remoção de dados pessoais das respostas do ChatGPT: se uma resposta do ChatGPT incluir informações pessoais identificáveis sobre você (como seu nome combinado com dados sensíveis ou privados), você pode enviar uma solicitação de remoção. A OpenAI analisará a solicitação e, se aprovada, tomará medidas para impedir que essas informações pessoais específicas sejam geradas em respostas futuras. Observe que essa opção existe como uma medida de segurança de privacidade e não significa que o ChatGPT mantenha perfis pessoais ou se lembre de usuários individuais entre conversas.

No geral, o Portal de Privacidade fornece o mecanismo formal para exercer seus direitos de dados integralmente quando as configurações do aplicativo não forem suficientes.

IA de código aberto vs. IA comercial: privacidade desde a concepção na prática

Os sistemas de IA diferem na forma como são construídos, implementados e governados. Uma das distinções mais importantes é entre modelos de código aberto, em que partes do sistema são publicamente acessíveis, e serviços comerciais de IA, em que o modelo e a infraestrutura são controlados centralmente por um único fornecedor.

O que "código aberto” significa para a segurança do DeepSeek

No contexto da IA, o termo código aberto refere-se à disponibilização do código ao público. Isso permite a inspeção independente para identificar problemas de segurança ou comportamentos inesperados no próprio código, especialmente em implantações auto-hospedadas.

O modelo DeepSeek R1 está disponível no GitHub sob a licença MIT. Isso permite o uso, modificação e distribuição gratuitos e irrestritos, inclusive para fins comerciais, a qualquer pessoa.

Do ponto de vista da segurança e da privacidade, a licença tem diversas implicações:

- O modelo pode ser auto-hospedado, mantendo as instruções e as respostas inteiramente dentro da infraestrutura local ou privada.

- Pesquisadores independentes podem executar testes de segurança para encontrar vulnerabilidades.

- As organizações podem aplicar seus próprios controles de acesso, registro de logs e medidas de conformidade.

Ao mesmo tempo, possuir código aberto não significa que haja total transparência em todo o processo de desenvolvimento. Para muitos sistemas de IA rotulados como de código aberto, a origem, a composição e o pré-processamento do conjunto de dados de treinamento não são tornados públicos, mesmo quando o código do modelo é divulgado. Isso restringe a verificação independente dos dados de treinamento do modelo e pode influenciar avaliações relativas à privacidade, viés e confiabilidade.

O DeepSeek não divulga publicamente conjuntos de dados de treinamento completos, o que está de acordo com essa limitação mais ampla e significa que a transparência no nível do código não se estende automaticamente aos dados de treinamento ou aos processos de desenvolvimento.

Infraestrutura centralizada e confiança no ChatGPT

O ChatGPT funciona em uma infraestrutura controlada pela OpenAI. Os usuários interagem com o modelo por meio de interfaces web ou de API, e todo o processamento de solicitações ocorre em sistemas gerenciados pela OpenAI.

Neste modelo:

- A OpenAI controla onde e como os dados são processados.

- Os usuários confiam em políticas documentadas em vez de inspeção direta do código.

- Os controles de segurança, as restrições de acesso e o monitoramento são aplicados centralmente.

Como o modelo e a infraestrutura subjacentes são proprietários, terceiros não podem auditar o sistema completo de forma independente. Isso limita a transparência, mas permite que a OpenAI padronize os controles de segurança e os aplique de forma consistente a todos os usuários.

Note que a OpenAI passou por avaliações controladas e revisões de conformidade, incluindo auditorias internas e avaliações de terceiros relacionadas a requisitos de segurança e requisitos regulamentares.

Medidas técnicas de segurança: criptografia e controle de acesso

Tanto o ChatGPT quanto o DeepSeek utilizam uma combinação de criptografia e controles de acesso para proteger os dados do usuário em suas plataformas. Essas medidas de segurança visam reduzir o risco de acesso não autorizado por terceiros em vez de garantir confidencialidade de ponta a ponta por parte do próprio provedor de serviços.

Criptografia em trânsito e em repouso

Ambas as plataformas aplicam criptografia para proteger os dados do usuário durante a transmissão e enquanto estiverem armazenados em seus sistemas.

O ChatGPT criptografa os dados em repouso usando criptografia padrão do setor, como o Advanced Encryption Standard (AES) de 256 bits. Todos os endpoints usam Transport Layer Security (TLS) 1.2 ou superior para criptografar os dados enviados entre usuários, a OpenAI e os provedores de serviços da OpenAI, o que ajuda a proteger as informações contra interceptação durante a transmissão pela rede. A segurança física de sua infraestrutura é gerenciada pelo Microsoft Azure.

O DeepSeek criptografa a comunicação entre usuários e seus servidores web usando HTTPS (TLS), garantindo que os dados em trânsito estejam protegidos contra interceptação passiva.

Controles de acesso e proteções em nível de conta

Os controles de acesso determinam quem pode acessar os dados do usuário dentro de uma plataforma e sob quais condições. A documentação oficial do DeepSeek afirma que o acesso ao servidor e ao banco de dados é restrito a pessoal autorizado por meio de autenticação e medidas de controle de acesso.

A OpenAI implementa medidas rigorosas de controle de acesso com base nos princípios do menor privilégio e da separação de funções. O acesso é concedido somente quando necessário para fins operacionais, de segurança ou legais e está sujeito a revisão regular.

Além disso, a OpenAI afirma que monitora e registra continuamente a atividade de acesso. Os registros são coletados e revisados centralmente para detectar atividades incomuns, e as permissões de acesso são auditadas periodicamente e revogadas quando não são mais necessárias. Os sistemas administrativos e internos exigem autenticação multifator (MFA), e as alterações de acesso interno são documentadas e revisadas.

Limitações da criptografia em chatbots de IA

Os chatbots de AI não usam criptografia de ponta a ponta (E2EE); para gerar respostas, serviços como ChatGPT e DeepSeek precisam descriptografar e processar suas mensagens em seus próprios servidores.

Isso significa que qualquer informação que você inserir pode ser usada internamente de acordo com as regras da plataforma (por exemplo, para operação do serviço, verificações de segurança, revisão de qualidade ou aprimoramento do modelo, dependendo das suas configurações). Em outras palavras, embora a criptografia proteja seus dados em trânsito e em repouso, ela não impede que o próprio provedor acesse esses dados.

No geral, a criptografia e os controles de acesso devem ser vistos como importantes proteções de segurança, e não como garantias de privacidade completa. É melhor presumir que qualquer informação que você compartilhe com um chatbot de IA pode ser armazenada ou analisada de acordo com as políticas do provedor.

Cenários de uso e hospedagem para empresas

Empresas que integram IA em seus fluxos de trabalho ou que fornecem acesso a informações proprietárias por meio de APIs precisam levar em consideração o isolamento de dados, o controle de acesso, a conformidade e a responsabilidade operacional. Essas considerações variam dependendo se uma ferramenta de IA é fornecida como um serviço hospedado ou implantada na infraestrutura interna.

ChatGPT Enterprise: controles de privacidade, governança e isolamento

O ChatGPT Enterprise foi projetado para organizações que desejam usar um serviço de IA hospedado, aplicando controles de governança e privacidade mais rigorosos do que os disponíveis em contas de consumidores.

A OpenAI não utiliza conteúdo enviado pelo ChatGPT Enterprise para treinar seus modelos. As conversas são isoladas no nível organizacional e o acesso é regido por controles administrativos, em vez de configurações individuais do usuário. Isso permite que as organizações gerenciem como a IA é usada internamente sem depender que os funcionários configurem as opções de privacidade por conta própria.

Do ponto de vista da governança, as organizações podem controlar o acesso do usuário, gerenciar políticas de uso e monitorar a atividade em todas as equipes. Isso oferece suporte aos requisitos internos de conformidade e aos processos de auditoria. A OpenAI ainda gerencia a infraestrutura centralmente, mas esses controles fornecem às empresas limites mais definidos para o tratamento de dados dentro do serviço. Isso é particularmente importante quando o ChatGPT é usado como uma ferramenta de IA para desenvolvedores ou como uma ferramenta de IA de inteligência de negócios, onde as solicitações podem incluir código proprietário, APIs internas, projetos de sistema ou dados analíticos confidenciais.

O ChatGPT Enterprise não altera o modelo de implantação hospedada. Os dados continuam sendo processados na infraestrutura gerenciada pela OpenAI, e as organizações continuam confiando nas práticas de segurança e nos controles de acesso internos da OpenAI. A diferença está na forma como os dados são governados e isolados no nível organizacional, e não em onde ou como a infraestrutura é operada.

Auto-hospedagem do DeepSeek: benefícios e responsabilidades

O DeepSeek pode ser auto-hospedado na infraestrutura interna da organização, como servidores locais ou ambientes de nuvem privada. Isso pode proporcionar menor latência em alguns ambientes, além de oferecer maior controle sobre a privacidade e a retenção de dados, bem como uma configuração personalizada. As instruções e as respostas não saem da rede da organização, simplificando a governança de dados e reduzindo a exposição à infraestrutura de terceiros.

Para organizações em áreas regulamentadas como finanças, saúde ou governo, a auto-hospedagem permite que elas utilizem suas medidas de segurança, processos de auditoria e regras de armazenamento de dados atuais diretamente com o sistema de IA. O acesso pode ser restrito por meio de sistemas de identidade internos, e o uso pode ser monitorado utilizando as mesmas ferramentas de registro e supervisão já implementadas para outras cargas de trabalho sensíveis.

No entanto, a auto-hospedagem transfere a responsabilidade para a organização. A empresa passa a ser responsável por proteger o ambiente, gerenciar os controles de acesso, monitorar o uso, lidar com atualizações e garantir a conformidade com as leis aplicáveis e as políticas internas. Além disso, pode exigir muitos recursos computacionais para executar e otimizar o modelo — e, diferentemente dos modelos baseados em API, que são gerenciados pelo provedor, será necessário conhecimento especializado para implantar e manter o sistema.

Em outras palavras, os resultados em termos de privacidade e segurança dependem de quão bem a organização projeta e opera seu ambiente, e não dos controles padrão da plataforma.

Como usar ferramentas de IA com mais segurança

ChatGPT, DeepSeek e outros chatbots de IA são sistemas de processamento de dados. Tudo o que você insere, seja digitando ou por voz, é armazenado, registrado e pode ser revisado e retido para fins operacionais. O mesmo se aplica a arquivos enviados. Isso cria riscos reais de exposição, especialmente quando as solicitações incluem dados pessoais, informações comerciais confidenciais ou contexto que podem ser usados indevidamente se acessados posteriormente.

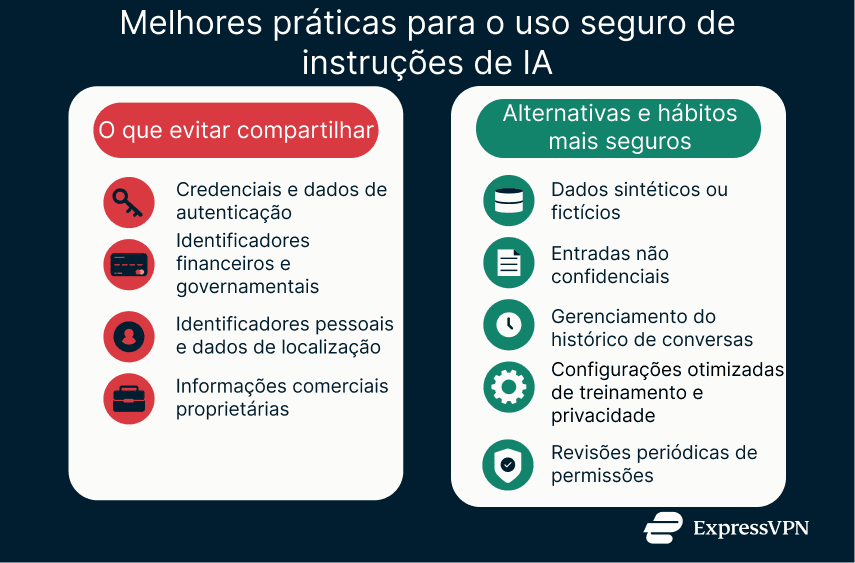

Melhores práticas para evitar o compartilhamento de informações confidenciais

Não considere o ChatGPT ou o DeepSeek como amigos ou confidentes. Se você tem informações que não contaria a um desconhecido, não as compartilhe com um chatbot de IA.

- Evite compartilhar identificadores e credenciais diretamente: nunca insira senhas, códigos de autenticação, números de cartão de crédito, dados bancários ou números de identificação emitidos pelo governo.

- Seja cauteloso com dados pessoais e de localização: nomes completos combinados com endereços, números de telefone ou detalhes de e-mail podem revelar mais do que você pretende, especialmente quando as perguntas incluem contexto pessoal.

- Trate informações comerciais como confidenciais por padrão: documentos internos, contratos, dados financeiros, listas de clientes e código-fonte não devem ser compartilhados em instruções, a menos que a ferramenta seja explicitamente aprovada para esse uso.

- Utilize entradas sintéticas ou anonimizadas sempre que possível: quando você precisar de ajuda com um cenário real, substitua os dados reais por exemplos sintéticos. Esses exemplos permitem obter respostas úteis sem expor informações reais. Ocultar informações importantes, como nomes de usuário, números de conta ou nomes de sistemas internos, reduz significativamente o risco, mantendo a eficácia da solicitação.

- Gerencie proativamente as configurações de retenção e treinamento: muitas ferramentas de IA oferecem opções para limpar o histórico de conversas ou desativar o uso de instruções para treinamento de modelos. Essas configurações nem sempre estão ativadas por padrão. Revisá-las e ajustá-las ajuda a limitar a retenção de dados a longo prazo e reduz a probabilidade de que instruções sensíveis sejam reutilizadas internamente.

- Revise permissões e hábitos de utilização regularmente: as ferramentas de IA evoluem rapidamente, assim como suas configurações. Revise periodicamente as opções de privacidade, os aplicativos conectados e as permissões do navegador para garantir que o acesso permaneça alinhado com a forma como você pretende usar a ferramenta. Essa supervisão é especialmente importante em dispositivos compartilhados ou em ambientes de equipe.

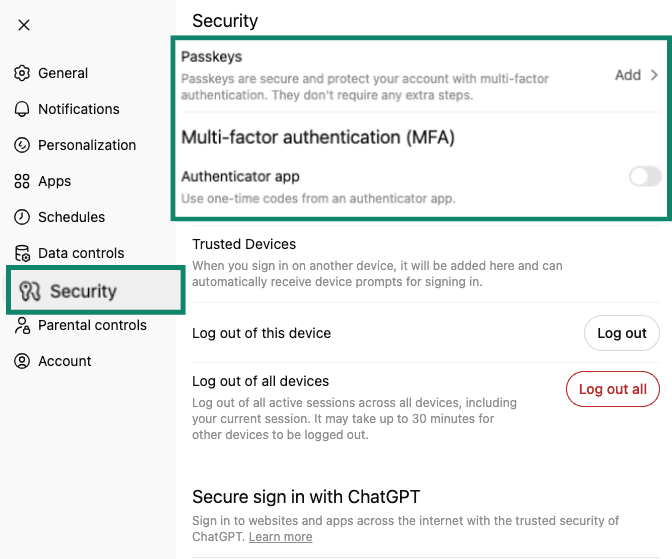

- Proteja sua conta com uma senha forte: seu histórico de conversas e utilização estão vinculados à sua conta, portanto uma senha comprometida pode expor conversas anteriores e potencialmente uma quantidade substancial de dados confidenciais. Use uma senha longa e única para proteger sua conta. Se você usa o ChatGPT, habilite a autenticação multifator com um aplicativo autenticador ou chaves de acesso para impedir acesso não autorizado (no momento da redação deste artigo, o DeepSeek não oferecia essas opções). Observe que a autenticação multifator (MFA) e as chaves de acesso não estão disponíveis para todos os usuários do ChatGPT: para verificar a disponibilidade desses recursos e ativá-los, acesse Settings (Configurações) > Security (Segurança).

Como uma VPN pode melhorar a privacidade no uso de IA

Usar uma rede privada virtual (VPN) com o ChatGPT adiciona uma camada de proteção em nível de rede às suas sessões. Uma VPN criptografa seu tráfego de internet, o que ajuda a impedir que terceiros, como operadores de rede ou invasores na mesma rede Wi-Fi, interceptem sua atividade. Ela também substitui seu endereço IP pelo do servidor VPN, reduzindo o rastreamento passivo no nível da conexão. Isso é especialmente útil ao acessar ferramentas de IA em redes públicas ou não seguras.

É importante entender as limitações. Ao fazer login para usar o serviço, sua atividade permanece associada à sua conta, independentemente de você estar usando uma VPN ou não. Uma VPN não oculta suas instruções do provedor de IA nem impede que a plataforma processe ou armazene suas entradas. O que ela oferece é proteção contra interceptação externa ao serviço de IA, o que é especialmente útil ao trabalhar remotamente ou viajar.

Em ambientes corporativos, as VPNs são frequentemente usadas em conjunto com implantações de IA corporativas ou modelos auto-hospedados para fornecer proteção em camadas. Ao contrário das VPNs comerciais, projetadas para anonimizar o tráfego de internet do consumidor, as VPNs corporativas geralmente fazem parte do perímetro da rede da organização, permitindo roteamento interno, acesso baseado em identidade e aplicação centralizada de políticas. Essa configuração reduz a exposição, limitando o fluxo de tráfego de IA e mantendo as solicitações confidenciais dentro de redes controladas.

Perguntas frequentes: dúvidas comuns sobre ChatGPT e DeepSeek

O ChatGPT é treinado com base em conversas de usuários?

Nas versões gratuita, Plus e Pro do ChatGPT, as conversas dos usuários podem ser usadas para aprimorar os modelos, dependendo das configurações da conta. Os usuários podem desativar esse uso por meio de suas configurações de privacidade. O ChatGPT não utiliza conversas de contas comerciais e corporativas para o treinamento de modelos.

Alguma das ferramentas pode ser usada para dados confidenciais ou regulamentados?

O ChatGPT Enterprise oferece garantias de governança e tratamento de dados para uso comercial, enquanto o DeepSeek pode ser auto-hospedado, mantendo os dados dentro dos sistemas internos. Em ambientes regulamentados, as organizações geralmente precisam de políticas claras, modelos de implantação aprovados e controles internos antes de usar ferramentas de IA com dados sensíveis.

É seguro usar uma VPN com chatbots de IA?

Usar uma VPN com chatbots de IA é seguro e não interfere no funcionamento das ferramentas. Uma VPN afeta a conexão de rede criptografando o tráfego e mascarando seu endereço IP, mas não altera a forma como o provedor de IA processa, armazena ou acessa suas instruções. Ela deve ser vista como uma medida complementar de privacidade, e não como um controle sobre o próprio chatbot.

Dê o primeiro passo para se proteger online. Experimente a ExpressVPN sem riscos.

Obtenha ExpressVPN